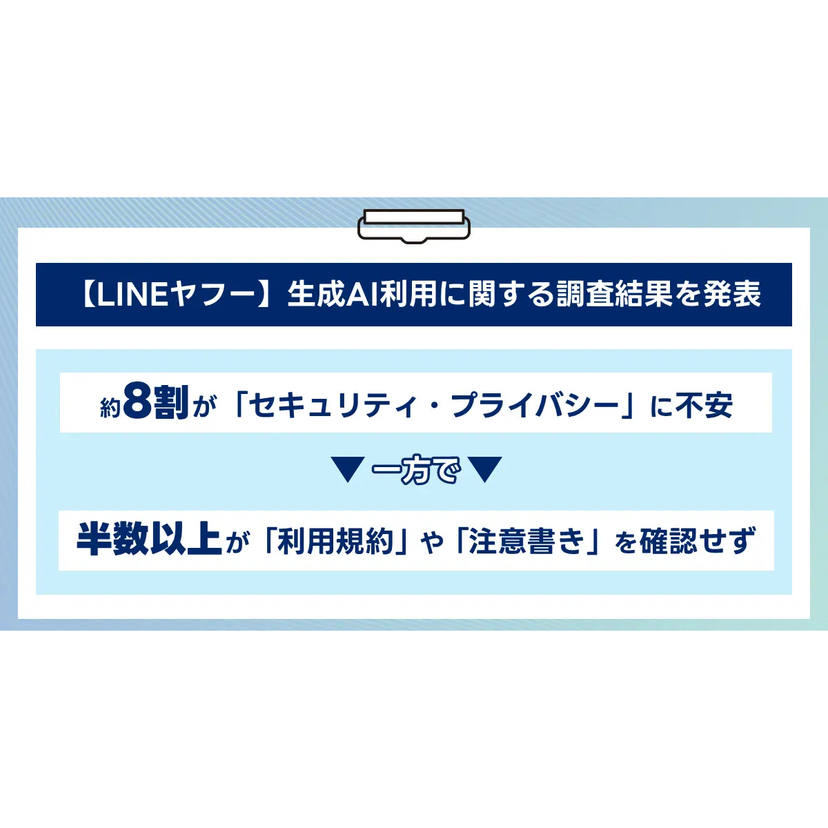

セキュリティやプライバシーへの不安を感じる人は78.7%

生成AIを利用する際、セキュリティやプライバシーが気になることが、「よくある」または「ときどきある」と回答した人は78.7%となり、多くのユーザーが生成AIに不安を感じながら利用している現状が伺えます。

生成AIを利用する上で不安に感じることは、「入力データの漏洩」で63.4%と最大

生成AIを利用する上で具体的な不安要素として、「自分が入力したデータの漏洩(63.4%)」が最多となり、情報の取り扱いに対する不安が顕著に現れる結果となりました。

次いで「自身の利用において、誤った情報に気づかずに使ってしまうこと(47.3%)」や「生成AIへの依存(46.2%)」が挙げられました。

生成AIが「事実と異なる回答をすること」への理解度は92.3%

生成AIが事実と異なる回答をする可能性について、「十分理解している」または「ある程度理解している」と回答した人は92.3%でした。

生成AIによる誤回答のリスクは、利用者の間で高いレベルで認知されています。

生成AIの回答を、「他の情報源で再確認する」人は76.9%

生成AIの回答を他の情報源で再確認するかという問いに対し、「毎回確認している」または「ときどき確認している」人は76.9%と高い水準でした。

「生成AIに入力したデータが学習に使われる可能性」の理解度は83.8%

入力内容が生成AIの学習に利用される可能性について、「十分理解している」または「ある程度理解している」人は83.8%でした。

データ流出への不安が強い一方で、学習への活用についても多くの人が認識しています。

採用基準は「自分の知識・経験」による主観判断が最多

生成AIの回答を採用する基準は「自分の知識や経験と照らし合わせて判断」が46.4%と最も多く、個人の知識と経験に委ねた判断で採用している人が多い結果となりました。

一方で、「他の情報源での確認」により採用する人は34.5%でした。

生成AIによる文章や画像が「著作権侵害になる可能性」への理解度は79.0%

生成AIが作った文章や画像が、既存の著作物に酷似して権利侵害になる可能性について、「十分理解している」または「ある程度理解している」人は79.0%と高い水準で理解が進んでいる結果となりました。

生成AIの最終判断は「人が行うべき」と考える人は95.1%

生成AIを使う際、最終的な判断は人が行うべきかという問いに、「そう思う」または「どちらかといえばそう思う」と答えた人は95.1%に上りました。

生成AIに依存しすぎず、自らが責任を持つという高い規範意識が浮き彫りになっています。

利用規約や注意書きを、確認していない人は52.0%

生成AI利用時に、規約や注意書きを「あまり確認しない」または「確認したことがない」と答えた人は52.0%となりました。

セキュリティやプライバシーへの不安は多くの人が感じている一方で、利用規約の確認など具体的な行動の間にはギャップがあることが分かりました。

調査概要

調査主体:LINEヤフー株式会社

調査名:生成AI利用に関する調査

調査方法:インターネット調査

調査期間:2026年1月16日〜1月20日

対象:過去1年以内に生成AIサービスを利用したことがある人

回答者数:1,056人

出典元:LINEヤフー株式会社

※詳細については出典元の企業にお問い合わせください。

【関連レポート】デジタル・トレンド白書2025 – with AI編|ダウンロードページ

https://manamina.valuesccg.com/articles/4703「デジタル・トレンド白書2025 – with AI編」は、急速に拡大し始めた「With AI」社会における消費者の行動変容を、国内最大規模の行動ログデータとアンケート調査に基づき分析したものです。各生成AIのユーザー推移やヘビーユーザーの属性分析、ChatGPT・Gemini等のサービス比較に加え、ビジネス・プライベートシーンでの活用実態、「AI彼女・彼氏」アプリの台頭など、AIトレンドに関する多角的な調査・コラムを収録しています。

マナミナは" まなべるみんなのデータマーケティング・マガジン "。

市場の動向や消費者の気持ちをデータを調査して伝えます。

編集部は、メディア出身者やデータ分析プロジェクト経験者、マーケティングコンサルタント、広告代理店出身者まで、様々なバックグラウンドのメンバーが集まりました。イメージは「仲の良いパートナー会社の人」。難しいことも簡単に、「みんながまなべる」メディアをめざして、日々情報を発信しています。